เป็นการเรียนรู้มาตรฐาน AI ที่เกี่ยวข้องในปัจจุบัน สำหรับใช้เป็นแนวทาง ในการอ้างอิงที่สากลยอมรับ วิธีการและมาตรการที่ช่วยป้องกันปัญหาความเสี่ยงในระบบ AI รวมถึงฝึกการประเมินและจัดการความเสี่ยงในโครงการ AI เพื่อให้สามารถควบคุมความเสี่ยงให้อยู่ในระดับที่ยอมรับได้ ตลอดจนนำความรู้ที่ได้มาปรับใช้ให้เหมาะสมกับองค์กร เพื่อให้ได้ระบบ AI ที่มีความน่าเชื่อถือและพร้อม ใช้งานได้ต่อไป เนื่องจากผู้เขียนมีโอกาสได้เข้าร่วมรับการฝึกอบรมเชิงปฏิบัติการ ที่จัดขึ้นสำนักงานพัฒนาวิทยาศาสตร์และเทคโนโลยีแห่งชาติ (สวทช.) โดยสถาบันพัฒนาบุคลากรแห่งอนาคต ระหว่างวันที่ 1-2 เมษายน 2568 รวมจำนวน 2 วัน ซึ่งได้รับความรู้ความเข้าใจและมีทักษะเกี่ยวกับการกำกับดูแล AI อย่างมีธรรมาภิบาลและความรับผิดชอบ โดยสรุปพอสังเขป ดังนี้ 1. หลักการจริยธรรมปัญญาประดิษฐ์ของสำนักงานคณะกรรมการดิจิทัลเพื่อเศรษฐกิจและสังคมแห่งชาติ (สดช) ประกอบด้วย 6 หลักการดังนี้ -

ความสามารถในการแข่งขันและการพัฒนาอย่างยั่งยืน (Competitiveness and Sustainable Development)

AI ควรได้รับการออกแบบและพัฒนาเพื่อสร้างประโยชน์และคุณค่าให้แก่มนุษย์ สังคม เศรษฐกิจ และสิ่งแวดล้อมอย่างยั่งยืน รวมถึงเพิ่มความสามารถในการแข่งขันและสร้างความเจริญให้แก่ทุกภาคส่วนอย่างเป็นธรรม -

ความสอดคล้องกับกฎหมาย จริยธรรม และมาตรฐานสากล (Laws, Ethics, and International Standards)

AI ควรได้รับการออกแบบและพัฒนาให้สอดคล้องกับกฎหมาย บรรทัดฐาน จริยธรรม คุณธรรมของมนุษย์ และมาตรฐานสากล โดยเคารพต่อความเป็นส่วนตัว เกียรติ สิทธิ เสรีภาพ และสิทธิมนุษยชน รวมทั้งควรได้รับการออกแบบโดยมีมนุษย์เป็นศูนย์กลางและเป็นผู้ตัดสินใจ (Human-Centered Design) และไม่ควรถูกออกแบบเพื่อใช้ในการกำหนดชะตาชีวิตของมนุษย์ -

ความโปร่งใสและความรับผิดชอบต่อผลของการกระทำ (Transparency and Accountability)

AI ควรได้รับการออกแบบและพัฒนาให้มีความโปร่งใสโดยจะต้องสามารถอธิบาย (Explainability) และคาดการณ์ผลลัพธ์จากการทำงานได้ มีการเฝ้าระวังและติดตามความผิดปกติ สามารถติดตามกิจกรรมต่างๆ ที่เกิดขึ้นโดย AI ได้ (Traceability) สามารถวินิจฉัยปัญหาและข้อผิดพลาดที่เกิดขึ้นได้ (Diagnosability) นอกจากนี้ควรมีการกำหนดหน้าที่และความรับผิดชอบ (Role and Responsibility) รวมถึงความรับผิดชอบต่อผลของการกระทำ (Accountability) ที่เกิดขึ้นจาก AI -

ความมั่นคงปลอดภัยและความเป็นส่วนตัว (Security and Privacy)

AI ควรได้รับการออกแบบและพัฒนาให้คำนึงถึงการรักษาความมั่นคงปลอดภัยและการรักษาความเป็นส่วนตัว โดยจัดให้มีมาตรการป้องกันการโจมตีทางไซเบอร์ และปฏิบัติตามกฎหมายคุ้มครองข้อมูลส่วนบุคคล -

ความเท่าเทียม หลากหลาย ครอบคลุม และเป็นธรรม (Fairness)

ในการใช้งาน AI อย่างเป็นธรรมและลดความอคติ (Bias) AI ควรได้รับการออกแบบและพัฒนาให้คำนึงความหลากหลาย (Diversity) ลดการเอนเอียง แบ่งแยก และเลือกปฏิบัติ (Discrimination) ต่อบุคคลหรือกลุ่มคนที่มีคุณลักษณะที่แตกต่างกัน (อาทิ อายุ เพศ ลักษณะทางกายภาพ เชื้อชาติ กลุ่มคนผู้ด้อยโอกาสในสังคม) รวมถึงสามารถพิสูจน์ถึงความเป็นธรรมสำหรับทุกฝ่ายที่เกี่ยวข้อง -

ความน่าเชื่อถือ (Reliability)

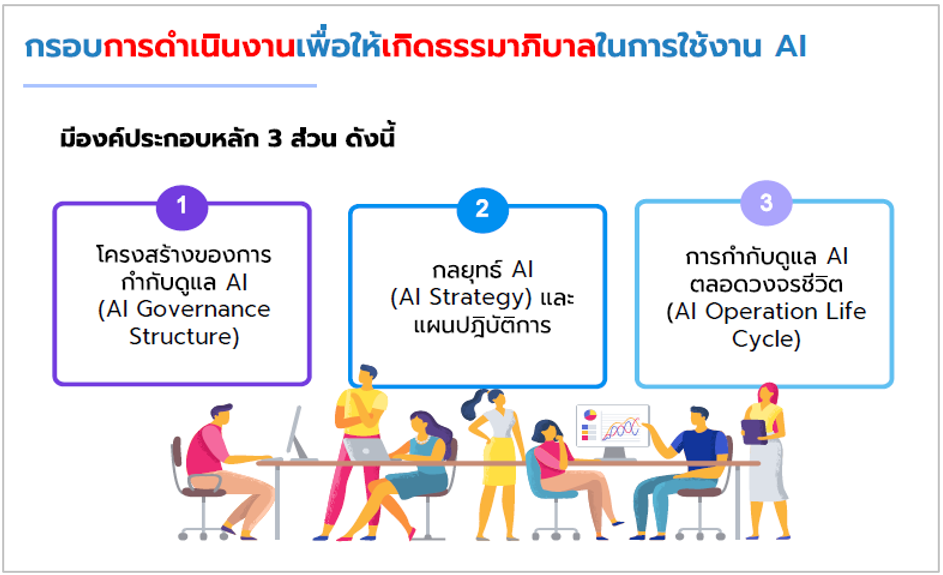

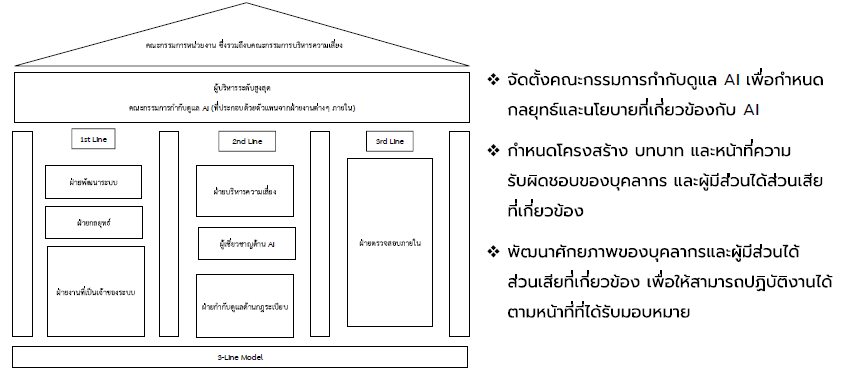

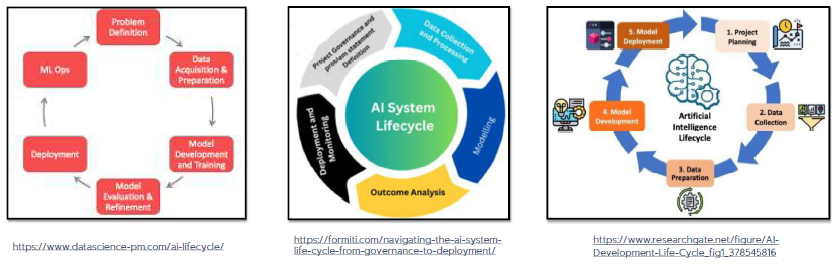

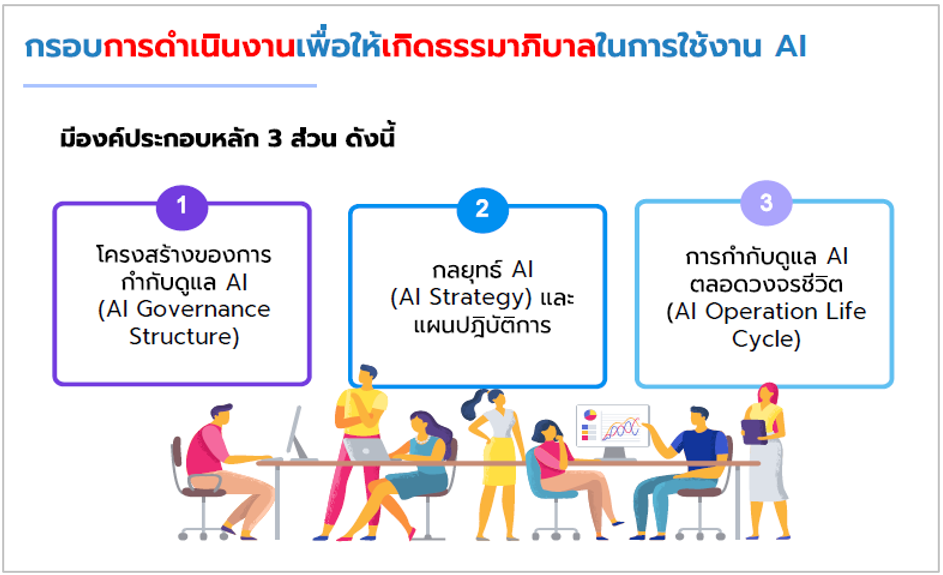

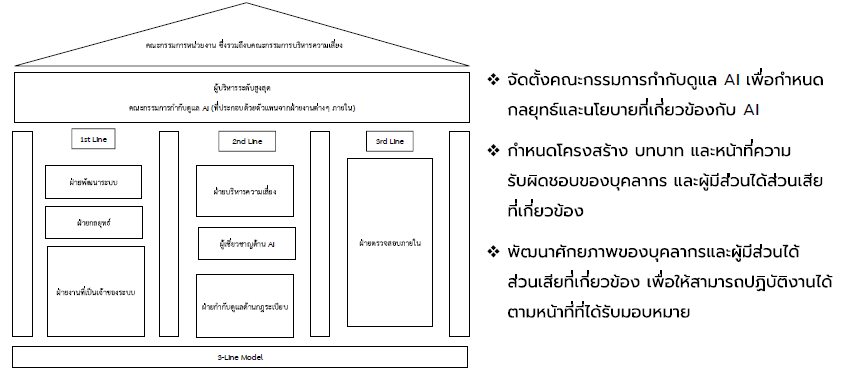

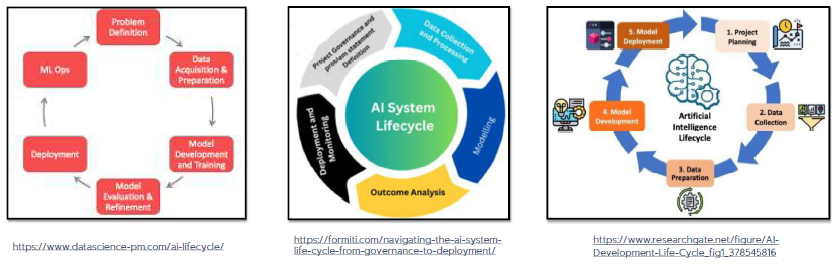

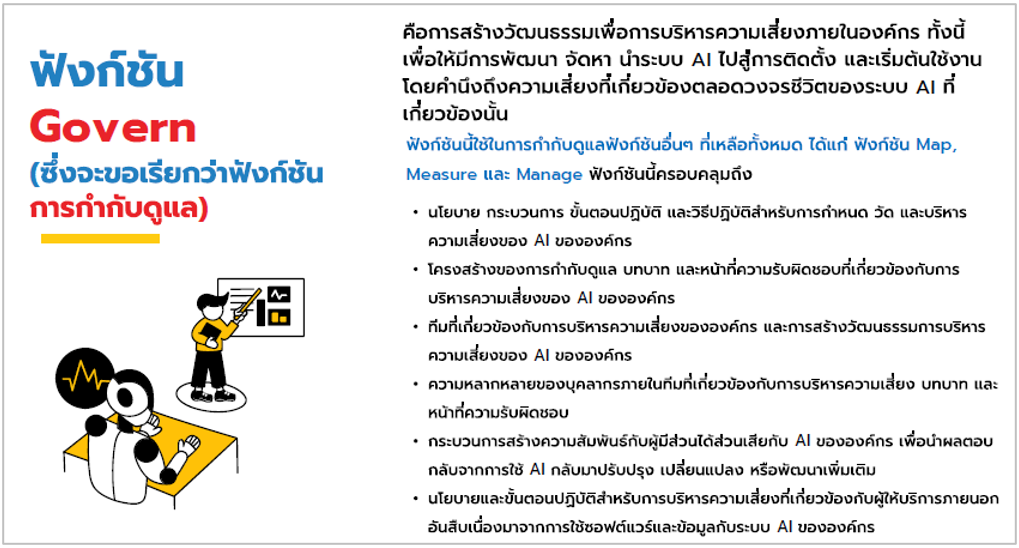

AI ควรได้รับการออกแบบและพัฒนาให้มีการทำงานอย่างถูกต้อง มีความน่าเชื่อถือ และสามารถจัดการกับความผิดพลาดที่เกิดขึ้นได้ในระดับหนึ่ง มีการควบคุมคุณภาพของข้อมูลที่นำมาใช้กับ AI มีกระบวนการและช่องทางรับฟังความคิดเห็นจากผู้ใช้งาน มีการรับเรื่องร้องเรียน แจ้งปัญหาที่พบ และมีการตอบสนองเรื่องร้องเรียนหรือปัญหาที่พบอย่างทันกาล  2. กรอบการดำเนินงานเพื่อให้เกิดธรรมาภิบาลในการใช้งาน AI  1. โครงสร้างชองการกำกับดูแล AI  2. กลยุทธ์ AI และแผนปฏิบัติการ อาจใช้ขั้นตอนการดำเนินการดังนี้ 1. ประเมินปัจจัยภายในและภายนอกองค์กร 2. วิเคราะห์ SWOT ขององค์กร 3. กำหนดทิศทางและกลยุทธ์ขององค์กร 4. กำหนดวัตถุประสงค์ภายใต้กลยุทธ์ขององค์กร 5. กำหนดตัวชี้วัด (Key Performance Indicator - KPI) ภายใต้วัตถุประสงค์ดังกล่าว 6. กำหนดโครงการ เป้าหมายของโครงการ ผู้รับผิดชอบ และงบประมาณที่จำเป็นต้องใช้ 7. รวบรวมโครงการทั้งหมดเป็นแผนปฏิบัติการขององค์กร เพื่อขอการอนุมัติจากคณะกรรมการกำกับดูแล AI 3. การกำกับดูแล AI ตลอดวงจรชีวิต  ประกอบด้วย 8 ขั้นตอนดังนี้ - การกำหนดปัญหา วิเคราะห์ความต้องการของผู้มีส่วนได้ส่วนเสีย, เก็บรวมรวมความต้องการ, กำหนดเกณฑ์การวัดความสำเร็จ เป็นต้น

- การเก็บรวบรวมข้อมูล ดำเนินการจัดหาข้อมูลจากแหล่งที่จัดเตรียมไว้, ประเมินคุณภาพของข้อมูล, ใช้การเข้ารหัสข้อมูลสำหรับข้อมูลที่มีความอ่อนไหว เป็นต้น

- การจัดเตรียมข้อมูล ทำความสะอาดข้อมูล, บูรณาการข้อมูลจากหลายๆ แหล่งเพื่อรวมข้อมูลเป็นหนึ่งเดียว, ปรับปรุงรูปแบบของข้อมูล เป็นต้น

- การออกแบบโมเดล เลือกอัลกอริทึมที่ต้องการนำมาใช้งาน, ออกแบบสถาปัตยกรรมของโมเดล, กำหนดมาตรการด้านความมั่นคงปลอดภัย เป็นต้น

- การฝึกหัดโมเดล เป็นการทำให้โมเดลเรียนรู้จากชุดข้อมูลของขั้นตอนที่ 3 ที่จะทำให้โมเดลสามารถมองเห็น Pattern และความสัมพันธ์ภายในชุดข้อมูลที่นำมาใช้ในการเรียนรู้

- การประเมินโมเดล เพื่อประเมินประสิทธิภาพของโมเดลที่ผ่านการฝึกหัดมาแล้วนั่นเอง ประเมินความถูกต้องและวิเคราะห์ความคลาดเคลื่อนในการประมวลผลของโมเดลว่าอยู่ในระดับใด กรณีที่ประสิทธิภาพของโมเดลอยู่ในระดับที่ยังไม่พึงพอใจ ให้กลับไปขั้นตอนที่ 5 เพื่อฝึกหัดโมเดลใหม่อีกครั้งหนึ่ง

- การนำโมเดลไปสู่การใช้งาน นำโมเดลที่ได้จากการพัฒนาเสร็จสิ้นไปใช้งาน

- การเฝ้าระวังและติดตามการทำงานของโมเดล เฝ้าระวังความผิดปกติของข้อมูลนำเข้า, นำผลตอบกลับจากผู้มีส่วนได้ส่วนเสียไปใช้ในการปรับปรุงประสิทธิภาพของโมเดล, รักษาความสอดคล้องกับกฎหมาย ระเบียบ หรือข้อบังคับที่เกี่ยวข้อง เป็นต้น

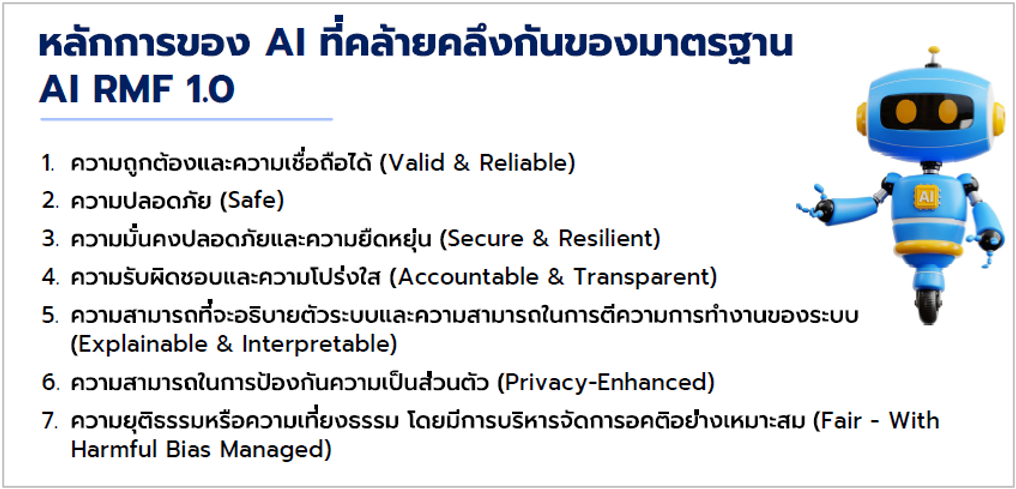

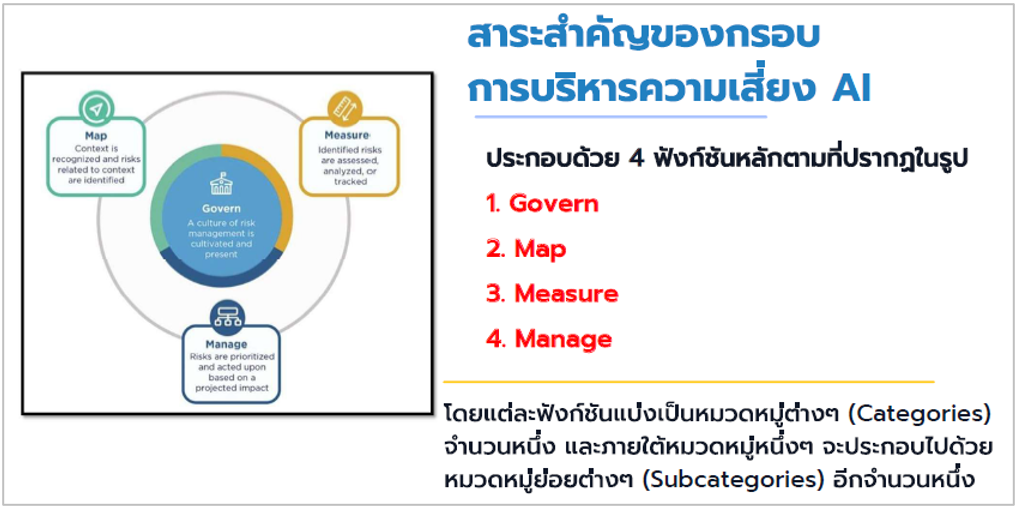

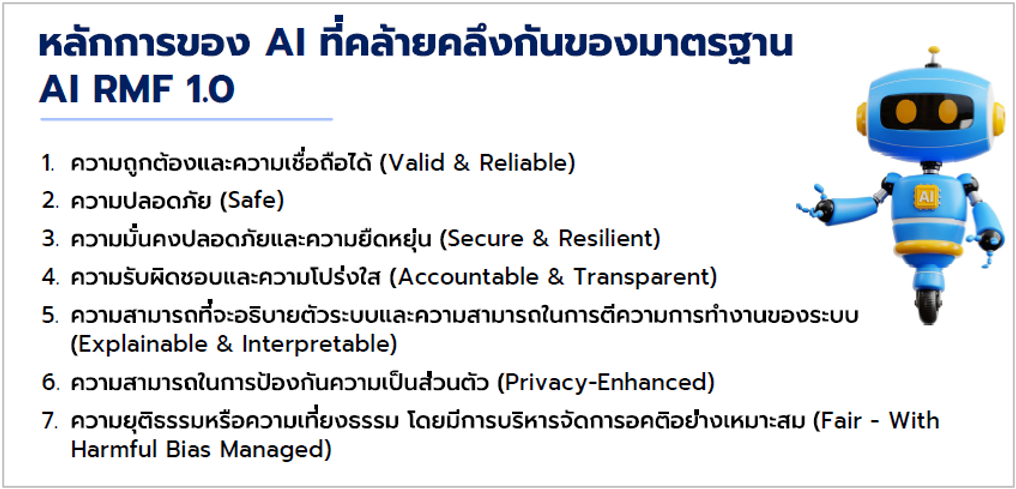

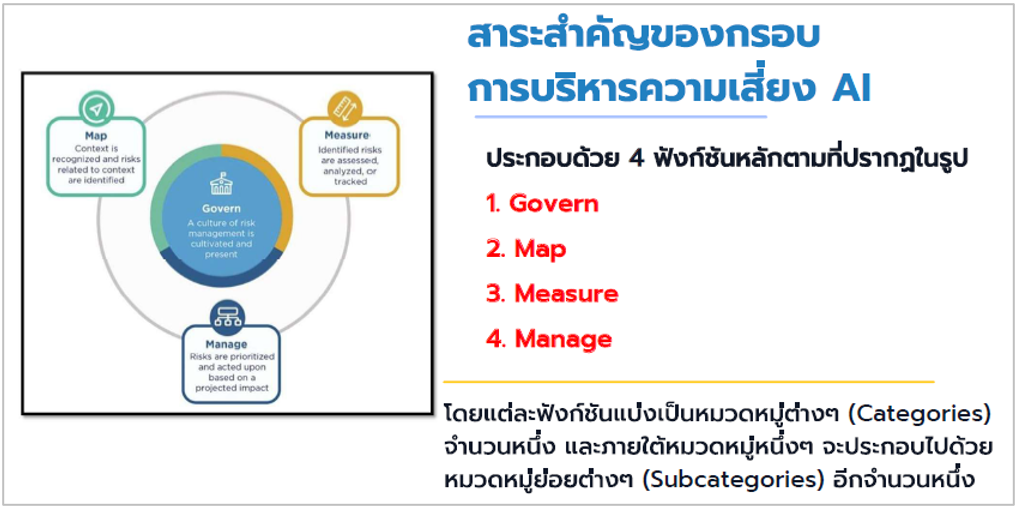

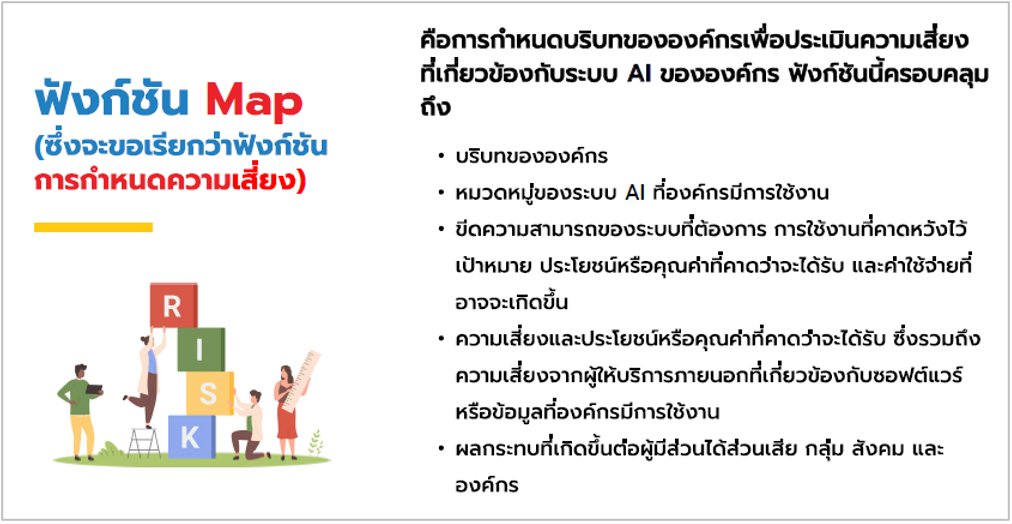

3. ความเสี่ยงที่เกี่ยวข้องกับ AI และกรอบการบริหารความเสี่ยงของ AI (Artificial Intelligence Risk Management Framework -- AI RMF 1.0) - ความเสี่ยงด้านความไม่เป็นธรรมและการเลือกปฏิบัติ

อคติที่มาจากโมเดล อคติที่มาจากชุดข้อมูล เช่น การใช้ชุดข้อมูลที่ขาดความหลากหลายหรือเอนเอียงไปในด้านใดด้านหนึ่งมากเกินไป - ความเสี่ยงด้านภัยคุกคามทางไซเบอร์

- ความเสี่ยงด้านการละเมิดข้อมูลส่วนบุคคล

- ความเสี่ยงด้านการไม่ปฏิบัติตามกฎหมาย ระเบียบ และข้อบังคับที่เกี่ยวข้อง

- ความเสี่ยงด้านความน่าเชื่อถือของระบบ

- ความเสี่ยงด้านความโปร่งใสของระบบ

- ความเสี่ยงด้านการไม่สามารถอธิบายการทำงานของระบบได้อย่างชัดเจน

- ความเสี่ยงด้านความปลอดภัยของระบบ

- ความเสี่ยงด้านคุณภาพของข้อมูล

ที่กล่าวมาเป็นเพียงบางส่วนของการกำกับดูแล AI อย่างมีธรรมาภิบาลและความรับผิดชอบ ซึ่งผู้สนใจศึกษารายละเอียดเพิ่มเติมหรือลงทะเบียนเข้าร่วมฝึกอบรมกได้ที่ สำนักงานพัฒนาวิทยาศาสตร์และเทคโนโลยีแห่งชาติ (สวทช.) โดยสถาบันพัฒนาบุคลากรแห่งอนาคต เว็บไวต์ : https://www.career4future.com ที่มา: เอกสารประกอบการอบรมการกำกับดูแล AI อย่างมีธรรมาภิบาลและความรับผิดชอบ วิทยากรโดย ดร. บรรจง หะรังษีรองกรรมการผู้จัดการ และที่ปรึกษาด้านความมั่นคงปลอดภัยระบบสารสนเทศบริษัท ที-เน็ต จำกัด

|